Закон Мура перестає діяти, і проєктувальники мікросхем шукають нові способи покращення продуктивності на існуючому технологічному рівні. У своєму блозі компанія Nvidia розповіла про новий метод проєктування чипів за допомогою нової моделі глибокого навчання PrefixRL.

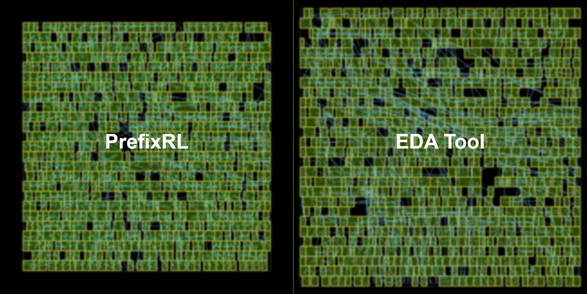

Ця технологія дозволяє перевершити стандартні системи автоматизованого проєктування інтегральних мікросхем, що застосовуються у промисловості. Існуючі варіанти автоматизації проєктування електроніки (EDA) використовують системи штучного інтелекту для оптимізації кремнієвої структури чіпа. Nvidia PrefixRL використовує більш глибокий та ефективний метод. Модель глибокого навчання з підкріпленням (deep reinforcement learning model) оптимізує структуру окремих логічних елементів та вузлів чипа, оптимізуючи площу ланцюгів. PrefixRL дозволяє домогтися зменшення площі мікросхеми, зниження затримок та енергоспоживання. Наприклад, площа 64-бітного суматора спроєктованого за допомогою Nvidia PrefixRL на 25% менше площі суматора, розробленого стандартними засобами EDA.

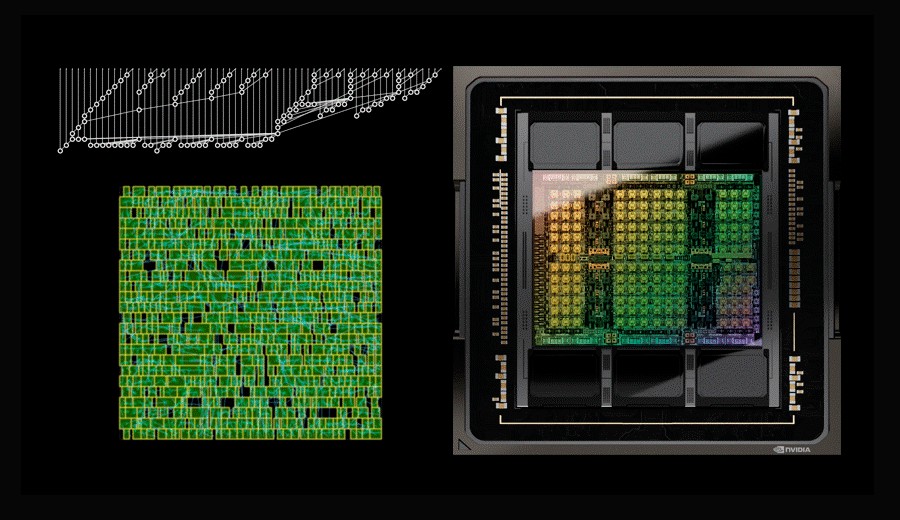

Прискорювач обчислень Hopper H100 вже спроєктований з використанням нового методу. Передовий GPU містить 13 000 вузлів, оптимізованих за допомогою PrefixRL.

PrefixRL — складне обчислювальне завдання. Для фізичного моделювання 64-бітного суматора знадобилося 256 CPU для кожного робочого GPU, а навчання зайняло понад 32 000 робочих годин GPU. Тому Nvidia розробила платформу розподілених обчислень Raptor, яка використовує переваги обладнання NVIDIA для розрахунків у промислових масштабах.

Джерело:

Nvidia